Rédigé et vérifié par un professeur diplômé de l’École Polytechnique, avec le niveau d’exigence attendu en classe préparatoire. Découvrir le professeur

Combien de lancers faut-il avant d’obtenir un 6 ? Combien d’essais avant le premier succès ? La loi géométrique modélise le rang du premier succès dans une suite d’épreuves de Bernoulli indépendantes. Seule loi discrète sans mémoire, elle est l’analogue discret de la loi exponentielle et apparaît constamment aux concours — en fiabilité, files d’attente et chaînes de Markov. Tu trouveras ici la définition rigoureuse, les démonstrations exigibles de l’espérance et de la variance, la loi binomiale négative (sa généralisation), des méthodes de reconnaissance et des exercices corrigés de niveau prépa.

I. Définition et contexte

A. L’attente du premier succès

Considère une expérience aléatoire à deux issues — succès (probabilité \(p\)) et échec (probabilité \(q = 1 – p\)) — répétée de manière indépendante. On modélise cette situation par une suite \((B_n)_{n \geq 1}\) de variables aléatoires de Bernoulli indépendantes de même paramètre \(p \in \,]0, 1]\).

On pose alors :

\(X = \min\{n \geq 1 : B_n = 1\}\)

La variable \(X\) représente le rang du premier succès. Elle prend ses valeurs dans \(\mathbb{N}^* = \{1, 2, 3, \ldots\}\). L’événement \(\{X = k\}\) signifie que les \(k – 1\) premières épreuves sont des échecs et que la \(k\)-ième est un succès. Par indépendance :

\(P(X = k) = \underbrace{q \cdot q \cdots q}_{k-1 \text{ échecs}} \cdot \, p = p \, q^{k-1}\)

C’est cette loi que l’on formalise ci-dessous.

B. Définition formelle de la loi géométrique

Définition — Loi géométrique

Soit \(p \in \,]0, 1]\) et \(q = 1 – p\). On dit qu’une variable aléatoire \(X\) suit la loi géométrique de paramètre \(p\), notée \(X \sim \mathcal{G}(p)\), si \(X(\Omega) = \mathbb{N}^*\) et :

\(\forall k \in \mathbb{N}^*, \quad P(X = k) = p \, q^{k-1} = p(1-p)^{k-1}\)

Programme CPGE : la loi géométrique est au programme de toutes les filières (MPSI, PCSI, MP, PC, PSI). Les démonstrations de l’espérance, de la variance et de l’absence de mémoire sont exigibles aux concours (marquées ⋆ dans cet article).

Exemple : on lance un dé équilibré à 6 faces. Soit \(X\) le rang du premier 6 obtenu. Alors \(X \sim \mathcal{G}(1/6)\) et :

\(P(X = k) = \displaystyle\frac{1}{6} \left(\displaystyle\frac{5}{6}\right)^{\!k-1}\)

Par exemple : \(P(X = 1) = \displaystyle\frac{1}{6} \approx 0{,}167\), \(\; P(X = 2) = \displaystyle\frac{5}{36} \approx 0{,}139\), \(\; P(X = 3) = \displaystyle\frac{25}{216} \approx 0{,}116\).

C. Convention alternative : nombre d’échecs

Certains ouvrages (notamment anglo-saxons) définissent la loi géométrique sur \(\mathbb{N}\) en posant \(Y = X – 1\), le nombre d’échecs avant le premier succès. Dans ce cas :

\(\forall k \in \mathbb{N}, \quad P(Y = k) = p \, q^{k}\)

Piège classique : toujours vérifier la convention de l’énoncé. Si la variable commence à \(0\), c’est le nombre d’échecs ; si elle commence à \(1\), c’est le rang du premier succès. Les formules d’espérance diffèrent : \(E(X) = 1/p\) dans la convention \(\mathbb{N}^*\), mais \(E(Y) = q/p\) dans la convention \(\mathbb{N}\). En CPGE française, la convention standard est \(X \in \mathbb{N}^*\).

| Convention \(\mathbb{N}^*\) (standard CPGE) | Convention \(\mathbb{N}\) | |

|---|---|---|

| Variable | Rang du premier succès | Nombre d’échecs avant le premier succès |

| Support | \(\{1, 2, 3, \ldots\}\) | \(\{0, 1, 2, \ldots\}\) |

| \(P(X = k)\) | \(p \, q^{k-1}\) | \(p \, q^{k}\) |

| Espérance | \(\displaystyle\frac{1}{p}\) | \(\displaystyle\frac{q}{p}\) |

| Variance | \(\displaystyle\frac{q}{p^2}\) | \(\displaystyle\frac{q}{p^2}\) |

Dans toute la suite de cet article, on adopte la convention \(\mathbb{N}^*\).

II. Propriétés et théorèmes

Cette section établit les résultats fondamentaux de la loi géométrique : vérification que c’est bien une loi de probabilité, fonction de répartition, puis la propriété qui la caractérise — l’absence de mémoire.

A. Vérification : c’est bien une loi de probabilité

Proposition ⋆

\(\displaystyle\sum_{k=1}^{+\infty} P(X = k) = \displaystyle\sum_{k=1}^{+\infty} p \, q^{k-1} = 1\)

Démonstration. Par changement d’indice \(j = k – 1\) :

\(\displaystyle\sum_{k=1}^{+\infty} p \, q^{k-1} = p \displaystyle\sum_{j=0}^{+\infty} q^{\, j}\)

Puisque \(q \in [0, 1[\,\), la série géométrique converge et \(\displaystyle\sum_{j=0}^{+\infty} q^{\, j} = \displaystyle\frac{1}{1 – q} = \displaystyle\frac{1}{p}\). Donc :

\(\displaystyle\sum_{k=1}^{+\infty} p \, q^{k-1} = p \cdot \displaystyle\frac{1}{p} = 1 \) ■

Les probabilités sont positives et de somme \(1\) : \(\mathcal{G}(p)\) est une loi de probabilité à support dénombrable.

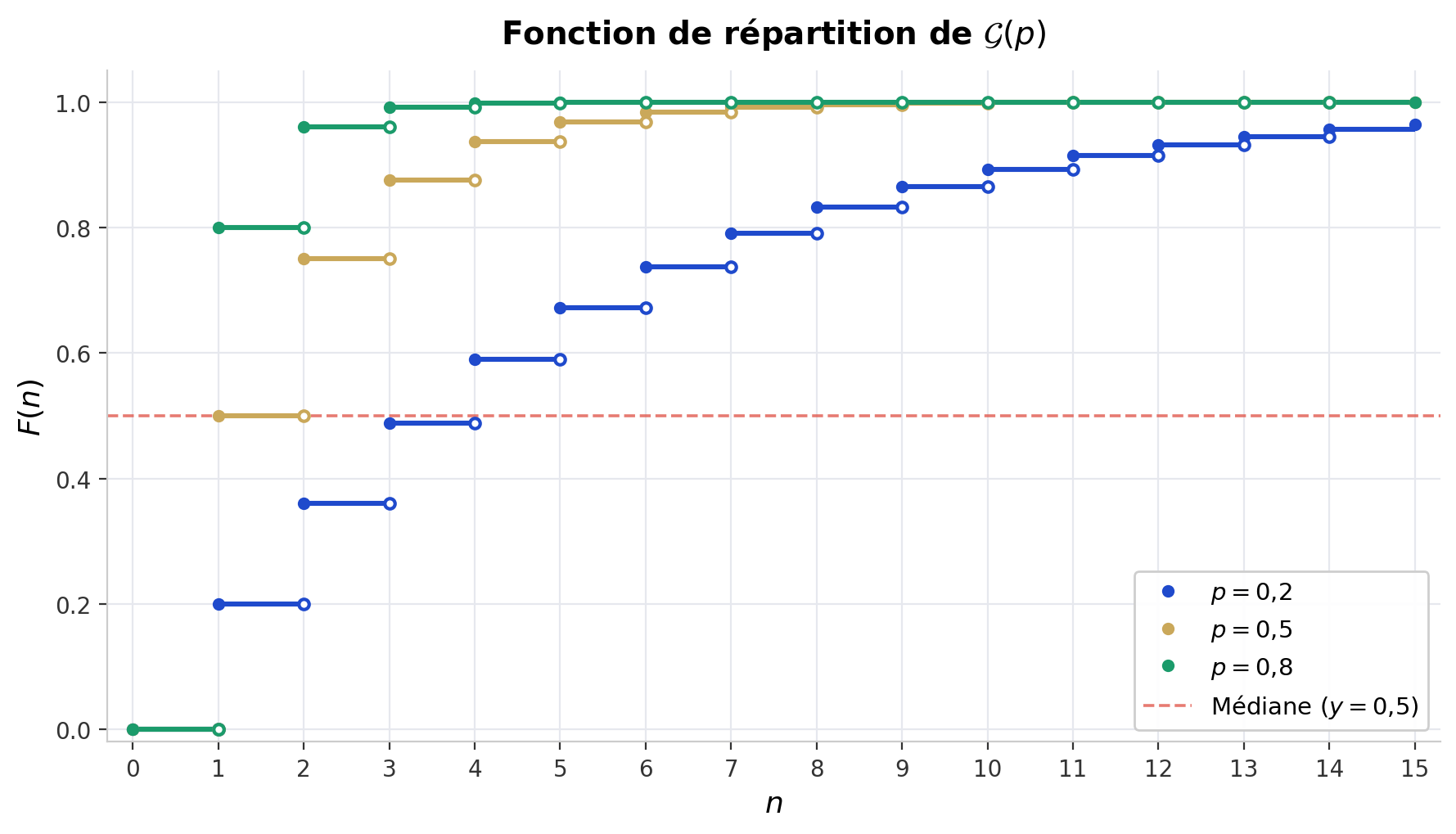

B. Fonction de répartition

Propriété ⋆ — Fonction de répartition

Soit \(X \sim \mathcal{G}(p)\). Pour tout \(n \in \mathbb{N}^*\) :

\(F_X(n) = P(X \leq n) = 1 – q^n = 1 – (1-p)^n\)

De manière équivalente : \(\quad P(X\) > \(n) = q^n = (1-p)^n\)

Démonstration. On somme une série géométrique partielle :

\(P(X \leq n) = \displaystyle\sum_{k=1}^{n} p \, q^{k-1} = p \cdot \displaystyle\frac{1 – q^n}{1 – q} = 1 – q^n \) ■

Formule à retenir : \(P(X\) > \(n) = q^n\). C’est la probabilité que les \(n\) premières épreuves soient toutes des échecs. Cette formule est plus maniable que la fonction de répartition et intervient dans presque tous les exercices.

Application : pour \(X \sim \mathcal{G}(1/6)\) (dé équilibré), la probabilité de ne pas avoir obtenu de 6 après \(10\) lancers est :

\(P(X\) > \(10) = \left(\displaystyle\frac{5}{6}\right)^{\!10} \approx 0{,}162\)

Autrement dit, \(P(X \leq 10) \approx 0{,}838\) : tu as environ 84 % de chances d’obtenir au moins un 6 en 10 lancers.

C. Absence de mémoire — propriété caractéristique

La propriété la plus remarquable de la loi géométrique est son absence de mémoire : le fait d’avoir déjà échoué \(m\) fois ne modifie en rien la probabilité d’attendre encore \(n\) épreuves supplémentaires.

Théorème — Absence de mémoire ⋆

Soit \(X \sim \mathcal{G}(p)\). Pour tous \(m, n \in \mathbb{N}^*\) :

\(P(X\) > \(m + n \mid X\) > \(m) = P(X\) > \(n)\)

Démonstration. Par définition de la probabilité conditionnelle, et puisque \(\{X\) > \(m + n\} \subset \{X\) > \(m\}\) :

\(P(X\) > \(m + n \mid X\) > \(m) = \displaystyle\frac{P(X\) > \(m + n)}{P(X\) > \(m)} = \displaystyle\frac{q^{m+n}}{q^m} = q^n = P(X\) > \(n) \) ■

Interprétation : si un joueur n’a pas encore gagné après \(m\) parties, sa probabilité de devoir attendre encore au moins \(n\) parties est identique à celle d’un joueur qui commence. Le passé n’influence pas l’avenir — c’est la traduction directe de l’indépendance des épreuves de Bernoulli.

Ce résultat admet une réciproque remarquable qui fait de l’absence de mémoire une caractérisation de la loi géométrique parmi les lois discrètes.

Théorème — Caractérisation de la loi géométrique

Soit \(X\) une variable aléatoire à valeurs dans \(\mathbb{N}^*\). Si \(X\) vérifie :

\(\forall (m, n) \in (\mathbb{N}^*)^2, \quad P(X\) > \(m + n \mid X\) > \(m) = P(X\) > \(n)\)

alors il existe \(p \in \,]0, 1]\) tel que \(X \sim \mathcal{G}(p)\). La loi géométrique est donc la seule loi discrète sans mémoire.

Démonstration. Posons \(f(n) = P(X\) > \(n)\) pour \(n \in \mathbb{N}\). La propriété d’absence de mémoire se réécrit :

\(\forall m, n \geq 1, \quad f(m + n) = f(m) \cdot f(n)\)

avec \(f(0) = P(X\) > \(0) = 1\) et \(0 \leq f(n) \leq 1\) pour tout \(n\). On reconnaît l’équation fonctionnelle de Cauchy sur \(\mathbb{N}\). Posons \(q = f(1)\). Par récurrence immédiate :

\(f(n) = f(1)^n = q^n\)

On en déduit, pour tout \(k \geq 1\) :

\(P(X = k) = f(k-1) – f(k) = q^{k-1} – q^k = q^{k-1}(1 – q)\)

En posant \(p = 1 – q\), on obtient \(P(X = k) = p \, q^{k-1}\) : c’est la loi \(\mathcal{G}(p)\). ■

Ce résultat est l’analogue discret du théorème de caractérisation de la loi exponentielle — seule loi continue sans mémoire.

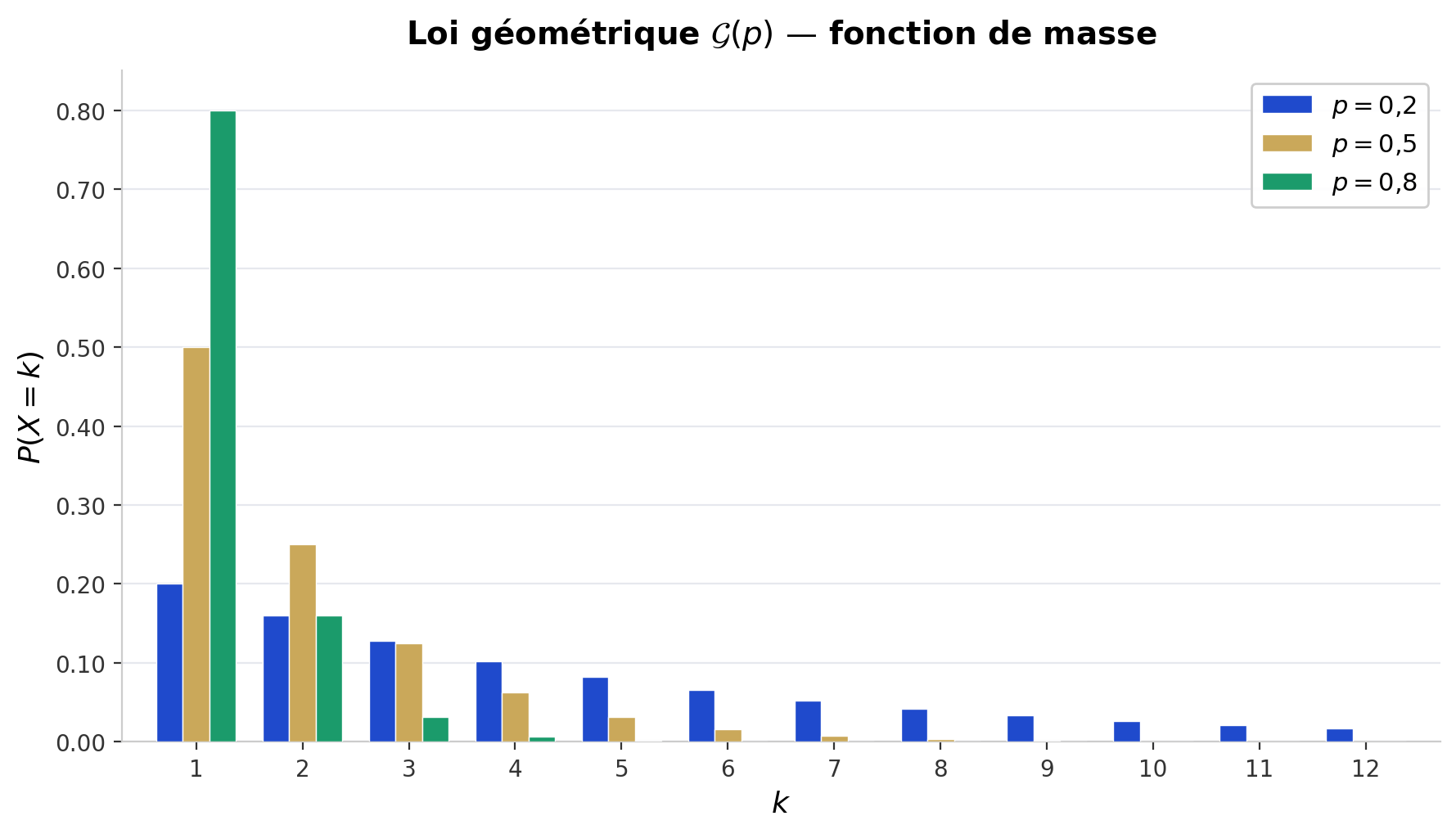

D. Représentation graphique

Le diagramme en barres de \(P(X = k)\) est une suite strictement décroissante, de type exponentiel : la masse de probabilité se concentre sur les petites valeurs de \(k\), d’autant plus que \(p\) est grand.

Pour \(p\) proche de \(1\), la loi est concentrée autour de \(k = 1\) : le succès arrive vite. Pour \(p\) petit, la queue s’étale et l’attente moyenne est longue.

III. Espérance, variance et écart-type

Les moments de la loi géométrique se déduisent de la convergence et de la dérivation des séries entières. On présente deux démonstrations de l’espérance — l’une élégante par la formule de la queue, l’autre par calcul direct — puis le calcul de la variance.

A. Espérance \(E(X) = 1/p\) — démonstration ⋆

Théorème ⋆

Soit \(X \sim \mathcal{G}(p)\). Alors \(X\) admet une espérance finie et :

\(E(X) = \displaystyle\frac{1}{p}\)

Méthode 1 — Formule de la queue (la plus élégante).

Pour une variable aléatoire \(X\) à valeurs dans \(\mathbb{N}^*\), on dispose de l’identité :

\(E(X) = \displaystyle\sum_{n=0}^{+\infty} P(X\) > \(n)\)

Rappel : cette identité se démontre en écrivant \(k = \displaystyle\sum_{n=0}^{k-1} 1\) puis en intervertissant les sommations dans \(\displaystyle\sum_{k \geq 1} k \, P(X = k)\) (Fubini discret). C’est un outil puissant, à connaître.

On applique avec \(P(X\) > \(n) = q^n\) :

\(E(X) = \displaystyle\sum_{n=0}^{+\infty} q^n = \displaystyle\frac{1}{1 – q} = \displaystyle\frac{1}{p} \) ■

Méthode 2 — Calcul direct par dérivation d’une série entière.

On part de la définition :

\(E(X) = \displaystyle\sum_{k=1}^{+\infty} k \cdot p \, q^{k-1}\)

On utilise l’identité classique (obtenue en dérivant la série géométrique \(\displaystyle\sum_{k=0}^{+\infty} x^k = \displaystyle\frac{1}{1-x}\)) :

\(\forall x \in ]-1, 1[, \quad \displaystyle\sum_{k=1}^{+\infty} k \, x^{k-1} = \displaystyle\frac{1}{(1 – x)^2}\)

En évaluant en \(x = q\) :

\(E(X) = p \cdot \displaystyle\frac{1}{(1 – q)^2} = \displaystyle\frac{p}{p^2} = \displaystyle\frac{1}{p} \) ■

Exemple : pour un dé équilibré, \(X \sim \mathcal{G}(1/6)\) donne \(E(X) = 6\). Il faut en moyenne 6 lancers pour obtenir un 6. Pour une pièce équilibrée, \(E(X) = 2\) lancers en moyenne pour un Pile.

B. Variance \(V(X) = q/p^2\) — démonstration ⋆

Théorème ⋆

Soit \(X \sim \mathcal{G}(p)\). Alors :

\(V(X) = \displaystyle\frac{q}{p^2} = \displaystyle\frac{1-p}{p^2}\)

et l’écart-type vaut \(\sigma(X) = \displaystyle\frac{\sqrt{q}}{p} = \displaystyle\frac{\sqrt{1-p}}{p}\).

Démonstration. On utilise la formule de König-Huygens : \(V(X) = E(X^2) – E(X)^2\). Il reste à calculer \(E(X^2)\).

On dérive une seconde fois la série géométrique. En partant de \(\displaystyle\sum_{k=1}^{+\infty} k \, x^{k-1} = \displaystyle\frac{1}{(1-x)^2}\) et en dérivant :

\(\displaystyle\sum_{k=2}^{+\infty} k(k-1) \, x^{k-2} = \displaystyle\frac{2}{(1-x)^3}\)

On calcule d’abord \(E[X(X-1)]\) :

\(E[X(X-1)] = \displaystyle\sum_{k=2}^{+\infty} k(k-1) \, p \, q^{k-1} = p \, q \displaystyle\sum_{k=2}^{+\infty} k(k-1) \, q^{k-2} = p \, q \cdot \displaystyle\frac{2}{(1-q)^3} = \displaystyle\frac{2 \, p \, q}{p^3} = \displaystyle\frac{2q}{p^2}\)

Puis :

\(E(X^2) = E[X(X-1)] + E(X) = \displaystyle\frac{2q}{p^2} + \displaystyle\frac{1}{p} = \displaystyle\frac{2q + p}{p^2}\)

Enfin :

\(V(X) = E(X^2) – E(X)^2 = \displaystyle\frac{2q + p}{p^2} – \displaystyle\frac{1}{p^2} = \displaystyle\frac{2q + p – 1}{p^2} = \displaystyle\frac{q}{p^2} \) ■

(On a utilisé \(2q + p – 1 = 2(1-p) + p – 1 = 1 – p = q\).)

C. Tableau récapitulatif

| Caractéristique | Formule |

|---|---|

| Support | \(\mathbb{N}^* = \{1, 2, 3, \ldots\}\) |

| Paramètre | \(p \in \,]0, 1]\) (probabilité de succès) |

| Loi de probabilité | \(P(X = k) = p \, q^{k-1}\) |

| Fonction de répartition | \(F_X(n) = 1 – q^n\) |

| Espérance | \(E(X) = \displaystyle\frac{1}{p}\) |

| Variance | \(V(X) = \displaystyle\frac{q}{p^2} = \displaystyle\frac{1-p}{p^2}\) |

| Écart-type | \(\sigma(X) = \displaystyle\frac{\sqrt{q}}{p}\) |

| Fonction génératrice | \(G_X(s) = \displaystyle\frac{ps}{1 – qs}\) pour \(|qs|\) < \(1\) |

| Propriété caractéristique | Absence de mémoire |

IV. La loi binomiale négative (généralisation)

La loi géométrique modélise l’attente du premier succès. Que se passe-t-il si l’on attend le \(r\)-ième succès ? On obtient la loi binomiale négative, dont la loi géométrique est le cas particulier \(r = 1\).

A. Définition et lien avec la loi géométrique

Définition — Loi binomiale négative

Soit \(r \in \mathbb{N}^*\) et \(p \in \,]0, 1]\). On dit que \(Y\) suit la loi binomiale négative de paramètres \((r, p)\), notée \(Y \sim \mathrm{BN}(r, p)\), si \(Y\) est le rang du \(r\)-ième succès dans une suite d’épreuves de Bernoulli indépendantes de paramètre \(p\). On a \(Y(\Omega) = \{r, r+1, r+2, \ldots\}\) et :

\(\forall k \geq r, \quad P(Y = k) = {k-1 \choose r-1} \, p^{\, r} \, q^{k-r}\)

Interprétation de la formule : pour que le \(r\)-ième succès tombe au rang \(k\), il faut exactement \(r – 1\) succès parmi les \(k – 1\) premières épreuves (d’où le coefficient \({k-1 \choose r-1}\)) puis un succès à l’épreuve \(k\).

Lien fondamental : si \(X_1, X_2, \ldots, X_r\) sont des variables indépendantes de loi \(\mathcal{G}(p)\), alors :

\(Y = X_1 + X_2 + \cdots + X_r \sim \mathrm{BN}(r, p)\)

En effet, \(X_i\) est le temps d’attente entre le \((i-1)\)-ième et le \(i\)-ième succès. La somme donne le rang du \(r\)-ième succès. En particulier, \(\mathcal{G}(p) = \mathrm{BN}(1, p)\).

Ne pas confondre : la loi binomiale \(\mathcal{B}(n, p)\) fixe le nombre d’épreuves \(n\) et compte les succès. La loi binomiale négative \(\mathrm{BN}(r, p)\) fixe le nombre de succès \(r\) et compte les épreuves. Ce sont des points de vue duaux.

B. Espérance et variance de la loi binomiale négative

Puisque \(Y = X_1 + \cdots + X_r\) avec des \(X_i \sim \mathcal{G}(p)\) indépendantes, la linéarité de l’espérance et l’additivité de la variance (par indépendance) donnent immédiatement :

Propriété — Moments de la loi binomiale négative

Soit \(Y \sim \mathrm{BN}(r, p)\). Alors :

\(E(Y) = \displaystyle\frac{r}{p} \qquad \text{et} \qquad V(Y) = \displaystyle\frac{r \, q}{p^2}\)

Exemple : on lance une pièce truquée (\(P(\text{Pile}) = 0{,}3\)) jusqu’à obtenir \(r = 5\) Piles. Le nombre total de lancers suit \(\mathrm{BN}(5 ;\, 0{,}3)\). On a \(E(Y) = 5/0{,}3 \approx 16{,}7\) lancers en moyenne et \(V(Y) = 5 \times 0{,}7 / 0{,}09 \approx 38{,}9\).

V. Méthode : reconnaître et utiliser la loi géométrique

A. Conditions d’application

Avant de poser \(X \sim \mathcal{G}(p)\), vérifie que les quatre conditions suivantes sont réunies :

- Épreuves répétées — on répète la même expérience aléatoire un nombre potentiellement infini de fois.

- Deux issues — chaque épreuve a exactement deux résultats : succès (probabilité \(p\)) ou échec (probabilité \(q = 1 – p\)).

- Indépendance — les épreuves sont mutuellement indépendantes.

- Rang du premier succès — la variable étudiée est le numéro de l’épreuve où le premier succès se produit.

Si la condition 4 est remplacée par « rang du \(r\)-ième succès », on est dans le cadre de la loi binomiale négative \(\mathrm{BN}(r, p)\) (section précédente). Si c’est le nombre de succès en \(n\) épreuves fixées, c’est la loi binomiale \(\mathcal{B}(n, p)\).

| Situation | Loi | Paramètre(s) |

|---|---|---|

| Nombre de succès en \(n\) épreuves fixées | Binomiale \(\mathcal{B}(n, p)\) | \(n, p\) |

| Rang du premier succès | Géométrique \(\mathcal{G}(p)\) | \(p\) |

| Rang du \(r\)-ième succès | Binomiale négative \(\mathrm{BN}(r, p)\) | \(r, p\) |

| Nombre d’événements rares sur un intervalle | Poisson \(\mathcal{P}(\lambda)\) | \(\lambda\) |

B. Résolution pas à pas

Face à un exercice de loi géométrique, suis cette démarche en 4 étapes :

- Identifier l’épreuve de Bernoulli — préciser ce qu’est un « succès », et exprimer sa probabilité \(p\).

- Poser la variable — écrire explicitement « soit \(X\) le rang du premier succès, \(X \sim \mathcal{G}(p)\) ».

- Traduire la question — reformuler en termes de \(P(X = k)\), \(P(X \leq n)\) ou \(P(X\) > \(n)\).

- Calculer — appliquer les formules. Pour un quantile, résoudre \(1 – q^n \geq \alpha\), soit \(n \geq \displaystyle\frac{\ln(1-\alpha)}{\ln q}\).

Astuce concours : quand l’énoncé demande « le plus petit entier \(n\) tel que \(P(X \leq n) \geq \alpha\) », on résout \(1 – q^n \geq \alpha\), soit \(q^n \leq 1 – \alpha\). Comme \(\ln q\) < \(0\), le passage au logarithme renverse l’inégalité :

\(n \geq \displaystyle\frac{\ln(1-\alpha)}{\ln q}\)

La réponse est \(n_0 = \left\lceil \displaystyle\frac{\ln(1-\alpha)}{\ln q} \right\rceil\) (partie entière supérieure).

VI. Exercices corrigés

Voici 8 exercices classés par difficulté croissante, de l’application directe (★) aux problèmes de concours (★★★★). Les exercices marqués I sont incontournables.

Exercice 1 — ★ I — Loi d’un temps d’attente

On lance un dé équilibré à 6 faces. Soit \(X\) le nombre de lancers nécessaires pour obtenir un 6 pour la première fois.

- Déterminer la loi de \(X\).

- Calculer \(P(X = 4)\), \(P(X \leq 3)\) et \(E(X)\).

Voir la correction

1. Chaque lancer est une épreuve de Bernoulli de paramètre \(p = 1/6\) (succès = obtenir un 6). Les lancers sont indépendants et \(X\) est le rang du premier succès. Donc \(X \sim \mathcal{G}(1/6)\).

2.

- \(P(X = 4) = \displaystyle\frac{1}{6}\left(\displaystyle\frac{5}{6}\right)^{\!3} = \displaystyle\frac{125}{1296} \approx 0{,}096\)

- \(P(X \leq 3) = 1 – \left(\displaystyle\frac{5}{6}\right)^{\!3} = 1 – \displaystyle\frac{125}{216} = \displaystyle\frac{91}{216} \approx 0{,}421\)

- \(E(X) = \displaystyle\frac{1}{p} = 6\) lancers en moyenne.

Exercice 2 — ★★ — Quantile et médiane

Soit \(X \sim \mathcal{G}(p)\). Déterminer le plus petit entier \(m\) tel que \(P(X \leq m) \geq 1/2\) (médiane de \(X\)). Application numérique : \(p = 0{,}1\).

Voir la correction

On résout \(P(X \leq m) \geq 1/2\), soit \(1 – q^m \geq 1/2\), c’est-à-dire \(q^m \leq 1/2\).

Comme \(\ln q\) < \(0\), on obtient :

\(m \geq \displaystyle\frac{\ln(1/2)}{\ln q} = \displaystyle\frac{-\ln 2}{\ln(1-p)}\)

D’où \(m = \left\lceil \displaystyle\frac{-\ln 2}{\ln(1-p)} \right\rceil\).

Application : pour \(p = 0{,}1\), \(q = 0{,}9\) :

\(m = \left\lceil \displaystyle\frac{-\ln 2}{\ln 0{,}9} \right\rceil = \left\lceil \displaystyle\frac{0{,}693}{0{,}105} \right\rceil = \lceil 6{,}58 \rceil = 7\)

Il faut 7 épreuves pour avoir au moins 50 % de chances de succès.

Exercice 3 — ★★ — Absence de mémoire en contexte

Un serveur reçoit des requêtes indépendantes. Chaque requête a une probabilité \(p = 0{,}05\) d’être malveillante. Soit \(X\) le rang de la première requête malveillante.

- Quelle est la loi de \(X\) ? Calculer \(E(X)\).

- Sachant que les 50 premières requêtes sont saines, quelle est la probabilité que la première requête malveillante arrive avant la 70ᵉ (incluse) ?

Voir la correction

1. \(X \sim \mathcal{G}(0{,}05)\). \(E(X) = 1/0{,}05 = 20\) requêtes en moyenne.

2. On cherche \(P(X \leq 70 \mid X\) > \(50)\). Par l’absence de mémoire :

\(P(X\) > \(50 + n \mid X\) > \(50) = P(X\) > \(n)\)

Donc \(P(X \leq 70 \mid X\) > \(50) = 1 – P(X\) > \(70 \mid X\) > \(50) = 1 – P(X\) > \(20)\).

Or \(P(X\) > \(20) = (0{,}95)^{20} \approx 0{,}358\).

Donc \(P(X \leq 70 \mid X\) > \(50) \approx 1 – 0{,}358 = 0{,}642\).

Remarque : c’est exactement \(P(X \leq 20) \approx 0{,}642\). Le passé (50 requêtes saines) ne change rien à la distribution future.

Exercice 4 — ★★★ — Fonction génératrice et moments

Soit \(X \sim \mathcal{G}(p)\).

- Calculer la fonction génératrice \(G_X(s) = E(s^X)\) et préciser son domaine de validité.

- En déduire \(E(X)\) et \(V(X)\).

Voir la correction

1.

\(G_X(s) = \displaystyle\sum_{k=1}^{+\infty} s^k \cdot p \, q^{k-1} = \displaystyle\frac{p \, s}{1} \displaystyle\sum_{k=1}^{+\infty} (qs)^{k-1} = \displaystyle\frac{p \, s}{1 – qs}\)

La série converge pour \(|qs|\) < \(1\), soit \(|s|\) < \(1/q\).

2. On a \(E(X) = G_X^\prime(1)\). Dérivons :

\(G_X^\prime(s) = \displaystyle\frac{p(1 – qs) + pqs}{(1 – qs)^2} = \displaystyle\frac{p}{(1 – qs)^2}\)

D’où \(G_X^\prime(1) = \displaystyle\frac{p}{(1-q)^2} = \displaystyle\frac{p}{p^2} = \displaystyle\frac{1}{p}\).

Pour la variance, on utilise \(V(X) = G_X^{\prime\prime}(1) + G_X^\prime(1) – [G_X^\prime(1)]^2\).

\(G_X^{\prime\prime}(s) = \displaystyle\frac{2pq}{(1 – qs)^3} \quad \Longrightarrow \quad G_X^{\prime\prime}(1) = \displaystyle\frac{2pq}{p^3} = \displaystyle\frac{2q}{p^2}\)

Donc :

\(V(X) = \displaystyle\frac{2q}{p^2} + \displaystyle\frac{1}{p} – \displaystyle\frac{1}{p^2} = \displaystyle\frac{2q + p – 1}{p^2} = \displaystyle\frac{q}{p^2}\)

Exercice 5 — ★★★ I — Somme de géométriques et loi binomiale négative

On lance une pièce truquée (\(P(\text{Pile}) = p = 0{,}4\)) jusqu’à obtenir \(r = 3\) Piles. Soit \(Y\) le nombre total de lancers.

- Justifier que \(Y \sim \mathrm{BN}(3 ;\, 0{,}4)\).

- Calculer \(P(Y = 5)\).

- Calculer \(E(Y)\) et \(V(Y)\).

Voir la correction

1. On note \(X_i\) le temps d’attente entre le \((i-1)\)-ième et le \(i\)-ième Pile. Les \(X_i\) sont indépendantes et \(X_i \sim \mathcal{G}(0{,}4)\). Alors \(Y = X_1 + X_2 + X_3 \sim \mathrm{BN}(3 ;\, 0{,}4)\).

2. Pour que le 3ᵉ Pile tombe au 5ᵉ lancer, il faut exactement 2 Piles parmi les 4 premiers lancers, puis un Pile au 5ᵉ :

\(P(Y = 5) = {4 \choose 2} (0{,}4)^3 (0{,}6)^2 = 6 \times 0{,}064 \times 0{,}36 = 0{,}13824\)

3. \(E(Y) = \displaystyle\frac{3}{0{,}4} = 7{,}5\) lancers en moyenne.

\(V(Y) = \displaystyle\frac{3 \times 0{,}6}{0{,}16} = \displaystyle\frac{1{,}8}{0{,}16} = 11{,}25\).

Exercice 6 — ★★★ — Minimum de géométriques indépendantes

Soient \(X_1 \sim \mathcal{G}(p_1)\) et \(X_2 \sim \mathcal{G}(p_2)\) deux variables aléatoires indépendantes.

- Montrer que \(Z = \min(X_1, X_2)\) suit une loi géométrique. Préciser son paramètre.

- Généraliser : si \(X_1, \ldots, X_n\) sont indépendantes avec \(X_i \sim \mathcal{G}(p_i)\), quelle est la loi de \(\min(X_1, \ldots, X_n)\) ?

Voir la correction

1. On calcule \(P(Z\) > \(k)\). L’événement \(\{Z\) > \(k\}\) signifie \(\{X_1\) > \(k\} \cap \{X_2\) > \(k\}\). Par indépendance :

\(P(Z\) > \(k) = P(X_1\) > \(k) \cdot P(X_2\) > \(k) = q_1^k \cdot q_2^k = (q_1 q_2)^k\)

Posons \(\tilde{q} = q_1 q_2 = (1 – p_1)(1 – p_2)\) et \(\tilde{p} = 1 – \tilde{q} = 1 – (1-p_1)(1-p_2)\).

Alors \(P(Z\) > \(k) = \tilde{q}^{\, k}\), ce qui caractérise \(Z \sim \mathcal{G}(\tilde{p})\) avec \(\tilde{p} = 1 – (1-p_1)(1-p_2) = p_1 + p_2 – p_1 p_2\).

2. Par récurrence immédiate : \(\min(X_1, \ldots, X_n) \sim \mathcal{G}(p^*)\) avec :

\(p^* = 1 – \displaystyle\prod_{i=1}^{n} (1 – p_i)\)

En particulier, si tous les \(p_i = p\) : \(p^* = 1 – (1-p)^n\).

Exercice 7 — ★★★★ — Simulation par inversion

Soit \(U\) une variable aléatoire suivant la loi uniforme sur \(]0, 1]\). On pose, pour \(p \in \,]0, 1]\) et \(q = 1 – p\) :

\(X = \left\lceil \displaystyle\frac{\ln U}{\ln q} \right\rceil\)

où \(\lceil \cdot \rceil\) désigne la partie entière supérieure. Montrer que \(X \sim \mathcal{G}(p)\).

Voir la correction

Pour \(k \in \mathbb{N}^*\), on a :

\(P(X \leq k) = P\!\left(\left\lceil \displaystyle\frac{\ln U}{\ln q} \right\rceil \leq k\right) = P\!\left(\displaystyle\frac{\ln U}{\ln q} \leq k\right)\)

Comme \(\ln q\) < \(0\), la division renverse l’inégalité :

\(P(X \leq k) = P(\ln U \geq k \ln q) = P(U \geq q^k)\)

Or \(U \sim \mathcal{U}(]0, 1])\), donc \(P(U \geq q^k) = 1 – q^k\).

On reconnaît la fonction de répartition de \(\mathcal{G}(p)\) : \(F_X(k) = 1 – q^k\). Donc \(X \sim \mathcal{G}(p)\). ■

Application : cet algorithme permet de simuler une loi géométrique à partir d’un générateur de nombres uniformes — un classique de la méthode d’inversion.

Exercice 8 — ★★★★ — Espérance du minimum (problème concours)

Soient \(X \sim \mathcal{G}(p)\) et \(Y \sim \mathcal{G}(r)\) deux variables indépendantes. Calculer \(P(X \leq Y)\) et \(E[\min(X, Y)]\).

Voir la correction

Calcul de \(P(X \leq Y)\) :

\(P(X \leq Y) = \displaystyle\sum_{k=1}^{+\infty} P(X = k) \cdot P(Y \geq k) = \displaystyle\sum_{k=1}^{+\infty} p(1-p)^{k-1} \cdot (1-r)^{k-1}\)

En posant \(q = 1 – p\) et \(s = 1 – r\) :

\(P(X \leq Y) = p \displaystyle\sum_{k=1}^{+\infty} (qs)^{k-1} = \displaystyle\frac{p}{1 – qs} = \displaystyle\frac{p}{1 – (1-p)(1-r)} = \displaystyle\frac{p}{p + r – pr}\)

Calcul de \(E[\min(X, Y)]\) :

D’après l’exercice 6, \(\min(X, Y) \sim \mathcal{G}(p^*)\) avec \(p^* = 1 – (1-p)(1-r) = p + r – pr\). Donc :

\(E[\min(X, Y)] = \displaystyle\frac{1}{p^*} = \displaystyle\frac{1}{p + r – pr}\)

La fiche de synthèse sur la loi géométrique

Définition, formules (espérance, variance, répartition), absence de mémoire et loi binomiale négative — tout l’essentiel sur une page recto.

Idéal pour réviser la veille du concours — en 5 minutes, tu as tout.

VII. Erreurs fréquentes et pièges classiques

Voici les erreurs les plus courantes sur la loi géométrique, avec diagnostic et correction.

Piège 1 — Confusion de convention

❌ Copie fautive : « \(X \sim \mathcal{G}(p)\), donc \(E(X) = q/p\). »

Diagnostic : l’élève applique la formule de la convention \(\mathbb{N}\) (nombre d’échecs) alors que \(X\) est définie sur \(\mathbb{N}^*\) (rang du premier succès).

✅ Correction : dans la convention \(\mathbb{N}^*\), \(E(X) = 1/p\). Toujours vérifier le support de la variable avant d’appliquer une formule.

Piège 2 — Inversion succès/échec

❌ Copie fautive : « On cherche le premier échec. On a un succès avec probabilité \(p = 0{,}8\), donc \(X \sim \mathcal{G}(0{,}8)\). »

Diagnostic : le paramètre de \(\mathcal{G}\) est la probabilité de l’événement qu’on attend, pas la probabilité de l’événement « courant ». Si on attend le premier échec, le succès de l’attente est l’échec de l’épreuve.

✅ Correction : « On attend le premier échec. La probabilité d’un échec est \(1 – 0{,}8 = 0{,}2\). Donc \(X \sim \mathcal{G}(0{,}2)\). »

Piège 3 — Absence de mémoire appliquée à tort

❌ Copie fautive : « Soit \(X \sim \mathcal{B}(10 ;\, 0{,}5)\). On sait que \(X\) > \(3\), donc par absence de mémoire, \(P(X\) > \(5 \mid X\) > \(3) = P(X\) > \(2)\). »

Diagnostic : la propriété d’absence de mémoire est exclusive à la loi géométrique (parmi les lois discrètes). Elle ne s’applique ni à la loi binomiale, ni à la loi de Poisson, ni à aucune autre loi discrète.

✅ Correction : vérifier que la variable suit bien une loi géométrique avant d’invoquer l’absence de mémoire.

Piège 4 — Erreur de raison dans la série géométrique

❌ Copie fautive : « \(\displaystyle\sum_{k=1}^{+\infty} p \, q^{k-1} = \displaystyle\frac{p}{1 – p}\). »

Diagnostic : confusion entre la raison \(q\) et le premier terme \(p\) dans la formule \(\displaystyle\frac{a}{1-r}\). Ici, la raison est \(q = 1-p\), pas \(p\).

✅ Correction : \(\displaystyle\sum_{k=1}^{+\infty} p \, q^{k-1} = \displaystyle\frac{p}{1 – q} = \displaystyle\frac{p}{p} = 1\).

VIII. Questions fréquentes

Quelle est la différence entre loi géométrique et loi binomiale ?

La loi binomiale \(\mathcal{B}(n, p)\) fixe le nombre d’épreuves \(n\) et compte le nombre de succès : c’est une variable bornée. La loi géométrique \(\mathcal{G}(p)\) fixe le nombre de succès (un seul) et compte le nombre d’épreuves nécessaires : c’est une variable à support infini. La binomiale répond à « combien de succès en \(n\) essais ? », la géométrique à « combien d’essais pour le premier succès ? ».

Pourquoi dit-on que la loi géométrique est sans mémoire ?

Parce que \(P(X\) > \(m + n \mid X\) > \(m) = P(X\) > \(n)\) : sachant qu’on a déjà échoué \(m\) fois, la probabilité d’attendre encore \(n\) épreuves est la même que si l’on repartait de zéro. Le « passé » (les échecs accumulés) n’influence pas le « futur ». C’est la traduction probabiliste de l’indépendance des épreuves. De plus, la loi géométrique est la seule loi discrète à posséder cette propriété.

Comment retrouver rapidement l'espérance de la loi géométrique ?

La méthode la plus rapide est la formule de la queue : \(E(X) = \displaystyle\sum_{n \geq 0} P(X\) > \(n) = \displaystyle\sum_{n \geq 0} q^n = 1/(1-q) = 1/p\). Si tu retiens que \(P(X\) > \(n) = q^n\) (probabilité de \(n\) échecs consécutifs), le résultat vient en une ligne.

Qu'est-ce que la loi binomiale négative ?

C’est la généralisation de la loi géométrique : si \(X \sim \mathcal{G}(p)\) modélise l’attente du 1er succès, la loi binomiale négative \(\mathrm{BN}(r, p)\) modélise l’attente du \(r\)-ième succès. Sa loi est \(P(Y = k) = {k-1 \choose r-1} p^r q^{k-r}\) pour \(k \geq r\), son espérance est \(r/p\) et sa variance \(rq/p^2\). Le cas \(r = 1\) redonne exactement la loi géométrique.

Quel est le lien entre loi géométrique et loi exponentielle ?

La loi exponentielle est l’analogue continu de la loi géométrique. Toutes deux modélisent un temps d’attente, toutes deux sont « sans mémoire » — et chacune est la seule loi de sa catégorie (discrète ou continue) à posséder cette propriété. Formellement, si \(X_n \sim \mathcal{G}(p/n)\), alors \(X_n / n\) converge en loi vers \(\mathrm{Exp}(p)\) quand \(n \to +\infty\). On peut aussi relier la loi géométrique à la loi de Poisson : si les événements arrivent selon un processus de Poisson, le temps discret d’attente du premier événement est géométrique.

Pour aller plus loin

Tu maîtrises désormais la loi géométrique — de sa définition à sa caractérisation par l’absence de mémoire, en passant par les démonstrations de l’espérance et de la variance. Pour consolider et approfondir :

- Variable aléatoire : cours complet, lois et formules — la vue d’ensemble du chapitre

- Espérance : formule, calcul et définition — propriétés générales et cas des lois classiques

- Variance : formule, calcul et définition — linéarité, Bienaymé, König-Huygens

- Loi binomiale : cours, formule et propriétés — pour maîtriser la distinction binomiale / géométrique

- Loi normale : cours et propriétés — la loi continue incontournable en probabilités

- Loi uniforme : discrète et continue — la loi de référence pour la simulation par inversion

- Loi exponentielle : cours et propriétés — l’analogue continu de la loi géométrique

- Loi de Poisson : cours, formule et propriétés — le lien avec les processus de comptage

- Fonction de répartition et densité — pour approfondir les outils transversaux

- Exercices variables aléatoires corrigés — pour t’entraîner sur l’ensemble du chapitre