Rédigé et vérifié par un professeur diplômé de l’École Polytechnique, avec un niveau de rigueur pensé pour le lycée et la prépa. Découvrir le professeur

Tu lances une pièce 10 fois et tu comptes le nombre de « face ». Tu passes un QCM de 20 questions en cochant au hasard. Tu contrôles 50 composants sur une chaîne de production pour repérer les défauts. Dans chacune de ces situations, tu répètes une même expérience à deux issues — succès ou échec — et tu comptes le nombre de succès. C’est exactement ce que modélise la loi binomiale.

Plus précisément, si la variable aléatoire \(X\) compte le nombre de succès obtenus lors de \(n\) répétitions indépendantes d’une épreuve de Bernoulli de paramètre \(p\), alors \(X\) suit la loi binomiale \(B(n,\,p)\). Dans cet article, tu trouveras la définition rigoureuse, la formule de \(P(X = k)\), le calcul de l’espérance et de la variance, des représentations graphiques et 5 exercices corrigés pas à pas. Les sections marquées « Prépa » couvrent le programme de prépa (CPGE).

Conforme au programme officiel de Terminale spécialité Mathématiques.

Tout le cours « Variables Aléatoires »

- 📖 Variable aléatoire : cours complet

- → Espérance

- → Variance

- → Écart-type

- → Loi binomiale (cette page)

- → Loi normale

- → Table de la loi normale

- → Loi de Poisson

- → Loi uniforme

- → Loi exponentielle

- → Loi géométrique

- → Fonction de répartition et densité

- ✏️ Exercices loi binomiale

- ✏️ Exercices variables aléatoires

I. Définition de la loi binomiale

A. Épreuve de Bernoulli et schéma de Bernoulli

Avant de définir la loi binomiale, il faut comprendre les deux briques qui lui servent de fondation : l’épreuve de Bernoulli et le schéma de Bernoulli.

Définition — Épreuve de Bernoulli

Une épreuve de Bernoulli de paramètre \(p\) est une expérience aléatoire à exactement deux issues :

- « Succès » avec la probabilité \(p\) (où \(0 \leq p \leq 1\))

- « Échec » avec la probabilité \(q = 1 – p\)

Exemples :

- Lancer une pièce équilibrée : « pile » = succès (\(p = 0{,}5\)).

- Tirer au panier : « marquer » = succès (\(p = 0{,}7\)).

- Contrôler une pièce usinée : « défectueuse » = succès (\(p = 0{,}02\)).

Définition — Schéma de Bernoulli

Un schéma de Bernoulli de paramètres \(n\) et \(p\) est la répétition de \(n\) épreuves de Bernoulli indépendantes et identiques (même probabilité de succès \(p\) à chaque épreuve).

L’indépendance signifie que le résultat d’une épreuve n’influence pas les suivantes. Par exemple, le résultat du 3ᵉ lancer de dé ne dépend ni du 1ᵉʳ ni du 2ᵉ.

B. La variable aléatoire binomiale X ~ B(n, p)

Définition — Loi binomiale

Soit un schéma de Bernoulli de paramètres \(n\) et \(p\). La variable aléatoire \(X\) qui compte le nombre de succès obtenus suit la loi binomiale de paramètres \(n\) et \(p\).

On note : \(X \sim B(n,\,p)\)

\(X\) prend ses valeurs dans \(\{0\,;\,1\,;\,2\,;\,\ldots\,;\,n\}\).

Cas particulier : quand \(n = 1\), la loi \(B(1,\,p)\) est tout simplement la loi de Bernoulli de paramètre \(p\). La loi binomiale généralise donc la loi de Bernoulli à \(n\) épreuves.

Checklist — Comment vérifier qu’une situation suit une loi binomiale

Avant d’appliquer la formule, coche ces 4 conditions :

- Le nombre d’épreuves \(n\) est fixé à l’avance.

- Chaque épreuve n’a que deux issues (succès ou échec).

- Les épreuves sont indépendantes.

- La probabilité de succès \(p\) est la même à chaque épreuve.

⚠️ Si une seule condition manque, ce n’est pas une loi binomiale. Par exemple, un tirage sans remise dans une urne viole les conditions 3 et 4 (sauf si la population est très grande par rapport à l’échantillon).

Pour bien situer la loi binomiale par rapport aux autres lois discrètes classiques :

| Loi | Ce qu’elle modélise | Paramètres | Valeurs de X |

|---|---|---|---|

| Bernoulli \(B(p)\) | 1 seule épreuve : succès ou échec | \(p\) | \(\{0\,;\,1\}\) |

| Binomiale \(B(n,\,p)\) | Nombre de succès en \(n\) épreuves | \(n,\,p\) | \(\{0\,;\,1\,;\,\ldots\,;\,n\}\) |

| Géométrique \(G(p)\) | Rang du premier succès | \(p\) | \(\{1\,;\,2\,;\,3\,;\,\ldots\}\) |

| Poisson \(\mathcal{P}(\lambda)\) | Nombre d’événements rares | \(\lambda\) | \(\{0\,;\,1\,;\,2\,;\,\ldots\}\) |

C. Coefficients binomiaux : rappel

La formule de la loi binomiale fait intervenir les coefficients binomiaux, qu’on utilise aussi dans le binôme de Newton.

Définition — Coefficient binomial

Pour \(n\) et \(k\) entiers naturels avec \(0 \leq k \leq n\) :

\(\displaystyle {n \choose k} = \displaystyle\frac{n!}{k!\,(n-k)!}\)

Ce nombre, lu « \(k\) parmi \(n\) », donne le nombre de façons de choisir \(k\) éléments parmi \(n\).

Exemples de calcul :

- \(\displaystyle {5 \choose 2} = \displaystyle\frac{5!}{2!\times 3!} = \displaystyle\frac{120}{2 \times 6} = 10\)

- \({4 \choose 0} = 1\) et \({4 \choose 4} = 1\)

- \({6 \choose 1} = 6\)

Propriétés utiles

- \({n \choose 0} = {n \choose n} = 1\) et \({n \choose 1} = n\)

- Symétrie : \({n \choose k} = {n \choose n-k}\)

- Formule de Pascal : \({n \choose k} = {n-1 \choose k-1} + {n-1 \choose k}\) (utile pour calculer de proche en proche)

Avec ces outils en main, tu es prêt à découvrir la formule centrale de la loi binomiale.

II. Formule de la loi binomiale : P(X = k)

A. La formule fondamentale

Propriété — Formule de la loi binomiale

Si \(X \sim B(n,\,p)\), alors pour tout entier \(k\) tel que \(0 \leq k \leq n\) :

\(\displaystyle P(X = k) = {n \choose k}\, p^{\,k}\,(1-p)^{n-k}\)

Décryptons chaque terme :

- \({n \choose k}\) : le nombre de façons d’obtenir exactement \(k\) succès parmi \(n\) épreuves (l’ordre ne compte pas).

- \(p^{\,k}\) : la probabilité d’obtenir \(k\) succès (chacun de probabilité \(p\)).

- \((1-p)^{n-k}\) : la probabilité d’obtenir \(n-k\) échecs (chacun de probabilité \(1-p\)).

Vérification : en utilisant la formule du binôme de Newton, on vérifie que la somme de toutes les probabilités vaut bien 1 :

\(\displaystyle \sum_{k=0}^{n} {n \choose k}\,p^{\,k}\,(1-p)^{n-k} = \bigl(p + (1-p)\bigr)^n = 1^n = 1\)

Probabilités cumulées — formules à connaître

- « Au plus \(k\) succès » : \(\displaystyle P(X \leq k) = \sum_{i=0}^{k} {n \choose i}\,p^{\,i}\,(1-p)^{n-i}\)

- « Au moins \(k\) succès » : \(P(X \geq k) = 1 – P(X \leq k-1)\) (événement contraire)

B. Méthode de calcul pas à pas

Pour calculer la probabilité \(P(X = k)\), suis ces 4 étapes :

- Identifier les paramètres \(n\) (nombre d’épreuves) et \(p\) (probabilité de succès).

- Calculer le coefficient binomial \({n \choose k}\).

- Calculer les puissances \(p^{\,k}\) et \((1-p)^{n-k}\).

- Multiplier les trois termes.

Exemple 1 — Lancer de dé

On lance un dé équilibré 4 fois. Soit \(X\) le nombre de 6 obtenus. Calculer \(P(X = 1)\).

Étape 1 : \(n = 4\), \(p = \displaystyle\frac{1}{6}\), \(k = 1\). On a \(X \sim B\!\left(4\,;\,\displaystyle\frac{1}{6}\right)\).

Étape 2 : \({4 \choose 1} = 4\).

Étape 3 : \(\left(\displaystyle\frac{1}{6}\right)^{\!1} = \displaystyle\frac{1}{6}\) et \(\left(\displaystyle\frac{5}{6}\right)^{\!3} = \displaystyle\frac{125}{216}\).

Étape 4 : \(\displaystyle P(X = 1) = 4 \times \displaystyle\frac{1}{6} \times \displaystyle\frac{125}{216} = \displaystyle\frac{500}{1296} = \displaystyle\frac{125}{324} \approx 0{,}386\)

Exemple 2 — QCM au hasard (événement contraire)

Un QCM comporte 8 questions avec 4 réponses chacune. Un élève coche au hasard. Soit \(X\) le nombre de bonnes réponses. Calculer \(P(X \geq 1)\).

\(X \sim B(8\,;\,0{,}25)\). On utilise l’événement contraire :

\(P(X \geq 1) = 1 – P(X = 0) = 1 – (0{,}75)^8 \approx 1 – 0{,}100 = 0{,}900\)

L’élève a 90 % de chances d’obtenir au moins une bonne réponse, même au hasard.

C. Calculer à la calculatrice (NumWorks, TI, Casio)

Pour les grandes valeurs de \(n\), le calcul à la main est vite fastidieux. Voici comment utiliser ta calculatrice :

Mode d’emploi par modèle

- NumWorks : menu Probabilités → Loi binomiale → saisir \(n\) et \(p\) →

BinomPDFpour \(P(X = k)\),BinomCDFpour \(P(X \leq k)\). - TI-83/84 :

2nd→DISTR→binompdf(n, p, k)pour \(P(X = k)\),binomcdf(n, p, k)pour \(P(X \leq k)\). - Casio Graph 35+ :

MENU→STAT→DIST→BINM→Bpdpour \(P(X = k)\),Bcdpour \(P(X \leq k)\).

Tu sais maintenant calculer n’importe quelle probabilité liée à une loi binomiale. La prochaine étape : résumer toute la distribution par ses indicateurs clés.

III. Espérance, variance et écart-type de B(n, p)

A. Espérance E(X) = np

Propriété — Espérance de la loi binomiale

Si \(X \sim B(n,\,p)\), alors :

\(E(X) = np\)

Interprétation : l’espérance donne le nombre moyen de succès sur \(n\) épreuves. Par exemple, si tu lances un dé 60 fois, tu obtiens en moyenne \(E(X) = 60 \times \displaystyle\frac{1}{6} = 10\) fois la face 6.

B. Variance V(X) = np(1 − p) et écart-type

Propriété — Variance et écart-type de la loi binomiale

Si \(X \sim B(n,\,p)\), en posant \(q = 1 – p\) :

\(V(X) = npq = np(1-p)\)

\(\sigma(X) = \sqrt{np(1-p)}\)

La variance mesure la dispersion du nombre de succès autour de l’espérance. L’écart-type \(\sigma(X)\), exprimé dans la même unité que \(X\), est plus intuitif à interpréter.

Exemple

On prélève 100 composants dans une production dont 5 % sont défectueux. \(X \sim B(100\,;\,0{,}05)\).

- \(E(X) = 100 \times 0{,}05 = 5\) défauts en moyenne.

- \(V(X) = 100 \times 0{,}05 \times 0{,}95 = 4{,}75\)

- \(\sigma(X) = \sqrt{4{,}75} \approx 2{,}18\)

On s’attend à environ \(5 \pm 2\) composants défectueux (à un écart-type près).

Remarque : la variance est maximale quand \(p = 0{,}5\) (incertitude maximale). Elle vaut alors \(V(X) = \displaystyle\frac{n}{4}\).

C. Démonstrations (Prépa)

Les démonstrations reposent sur la décomposition de \(X\) en somme de variables de Bernoulli indépendantes.

Décomposition fondamentale

Si \(X \sim B(n,\,p)\), alors \(X = X_1 + X_2 + \cdots + X_n\) où les \(X_i\) sont des variables de Bernoulli \(B(p)\) indépendantes. Chaque \(X_i\) vaut 1 si la \(i\)-ème épreuve est un succès, 0 sinon.

Démonstration de \(E(X) = np\) :

Pour chaque \(X_i \sim B(p)\) : \(E(X_i) = 0 \times (1-p) + 1 \times p = p\).

Par linéarité de l’espérance (qui ne nécessite pas l’indépendance) :

\(E(X) = E(X_1) + E(X_2) + \cdots + E(X_n) = \underbrace{p + p + \cdots + p}_{n \text{ termes}} = np\)

Démonstration de \(V(X) = np(1-p)\) :

Pour chaque \(X_i\) :

\(V(X_i) = E(X_i^2) – \bigl[E(X_i)\bigr]^2 = p – p^2 = p(1-p)\)

Comme les \(X_i\) sont indépendantes, la variance de la somme est la somme des variances :

\(V(X) = V(X_1) + V(X_2) + \cdots + V(X_n) = np(1-p)\)

Ces résultats permettent de résumer la loi binomiale par deux nombres. Mais pour visualiser la forme de la distribution, rien ne vaut un graphique.

IV. Représentation graphique de la loi binomiale

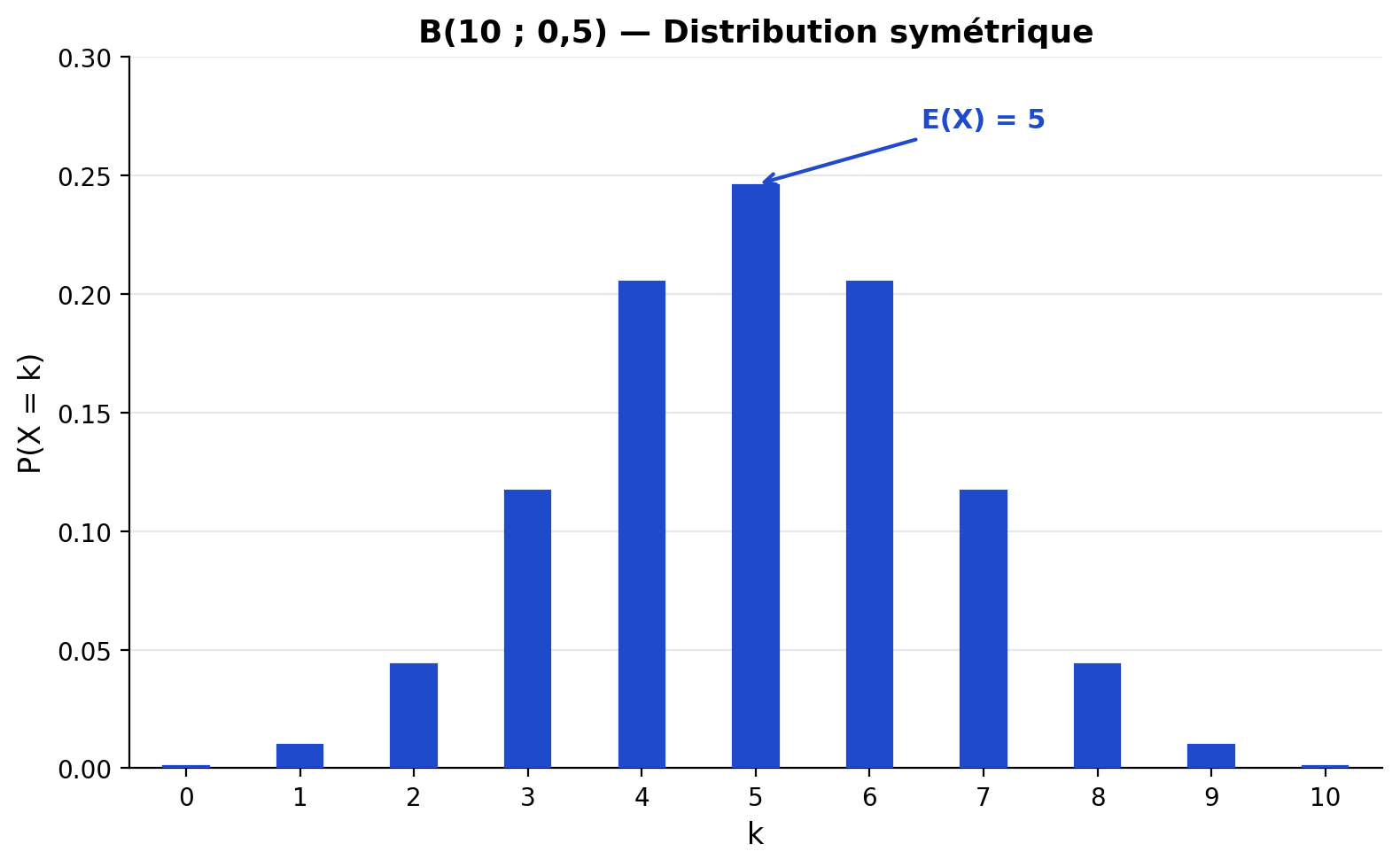

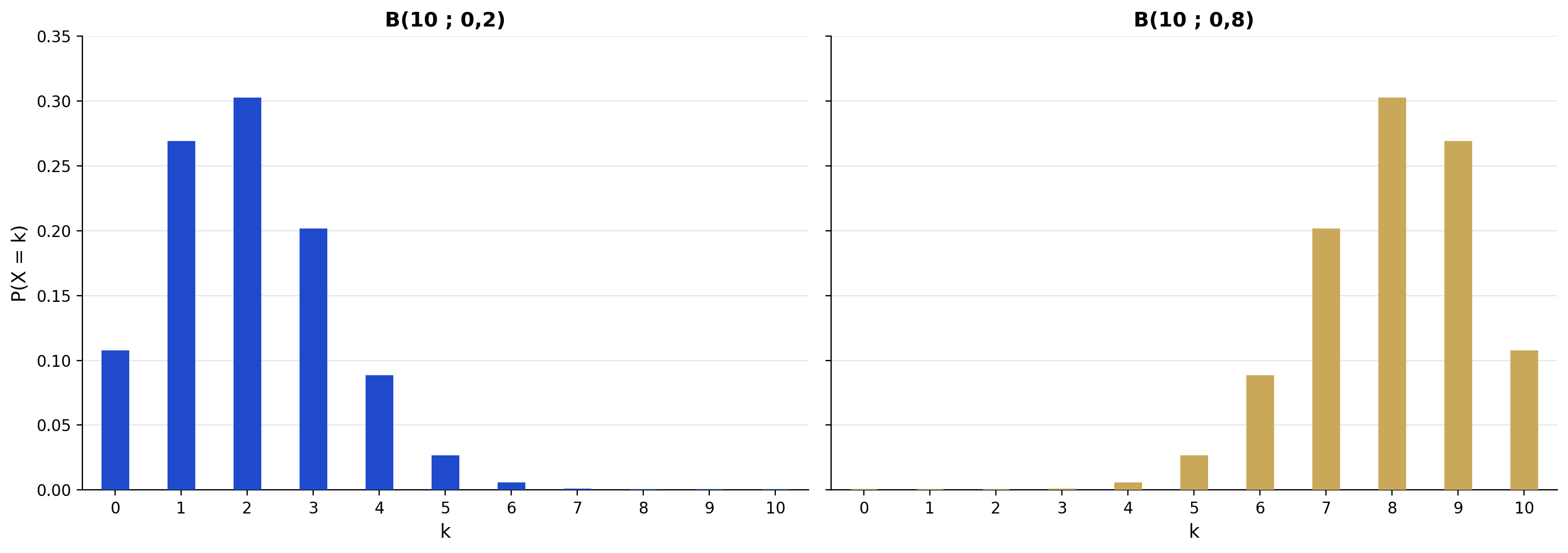

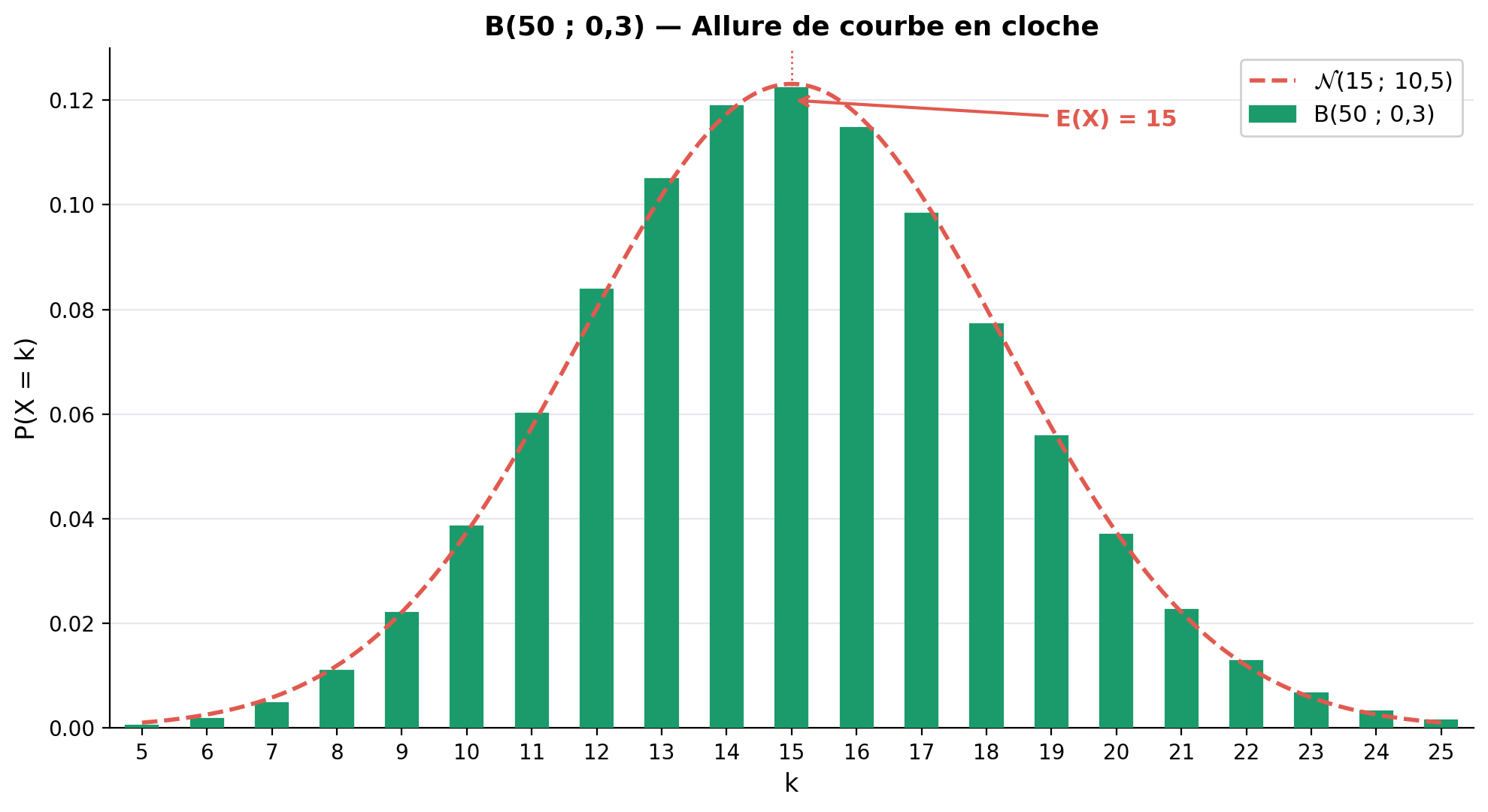

La loi binomiale se représente par un diagramme en bâtons : en abscisse les valeurs \(k \in \{0,\,1,\,\ldots,\,n\}\), en ordonnée les probabilités \(P(X = k)\).

Quand \(p = 0{,}5\), la distribution est symétrique autour de l’espérance \(E(X) = np\).

Quand \(p \neq 0{,}5\), la distribution est asymétrique : concentrée vers les petites valeurs si \(p\) est petit, vers les grandes si \(p\) est grand. Observe la symétrie parfaite entre \(B(10\,;\,0{,}2)\) et \(B(10\,;\,0{,}8)\) : l’une est le miroir de l’autre.

Quand \(n\) augmente, le diagramme se « lisse » et prend l’allure d’une courbe en cloche. C’est l’intuition du théorème de Moivre-Laplace que tu découvriras dans la section V. La fonction de répartition \(F(x) = P(X \leq x)\) est quant à elle une fonction en escalier, avec un saut de hauteur \(P(X = k)\) en chaque entier \(k\).

V. Approximations de la loi binomiale (Prépa)

Quand \(n\) est grand, la formule exacte \({n \choose k}\,p^{\,k}\,(1-p)^{n-k}\) peut devenir très lourde à calculer. Deux théorèmes classiques permettent d’approcher la loi binomiale par une loi plus simple, selon la nature des paramètres.

A. Approximation par la loi de Poisson (n grand, p petit)

Théorème (approximation poissonnienne)

Si \(X_n \sim B(n,\,p_n)\) avec \(n \to +\infty\), \(p_n \to 0\) et \(np_n \to \lambda\) (fini et fixé), alors pour tout \(k \in \mathbb{N}\) :

\(\displaystyle P(X_n = k) \longrightarrow e^{-\lambda}\,\displaystyle\frac{\lambda^k}{k!}\)

Autrement dit, \(B(n,\,p_n)\) converge vers la loi de Poisson \(\mathcal{P}(\lambda)\).

Règle pratique : on utilise l’approximation quand \(n \geq 30\), \(p \leq 0{,}1\) et \(np \leq 10\). On pose \(\lambda = np\).

Exemple

Une machine produit 1 % de pièces défectueuses. On en prélève 200. \(X \sim B(200\,;\,0{,}01)\).

Conditions vérifiées : \(n = 200 \geq 30\), \(p = 0{,}01 \leq 0{,}1\), \(\lambda = np = 2 \leq 10\).

\(\displaystyle P(X = 3) \approx e^{-2}\,\displaystyle\frac{2^3}{3!} = e^{-2} \times \displaystyle\frac{8}{6} \approx 0{,}1353 \times 1{,}333 \approx 0{,}180\)

Valeur exacte : \(P(X = 3) \approx 0{,}182\). L’approximation est excellente.

B. Théorème de Moivre-Laplace (approximation normale)

Théorème de Moivre-Laplace

Si \(X \sim B(n,\,p)\), la variable centrée réduite :

\(\displaystyle Z_n = \displaystyle\frac{X – np}{\sqrt{np(1-p)}}\)

converge en loi vers la loi normale centrée réduite \(\mathcal{N}(0,\,1)\) quand \(n \to +\infty\).

Règle pratique : l’approximation est fiable dès que \(np \geq 5\) et \(n(1-p) \geq 5\). Pour lire les probabilités, on utilise la table de la loi normale centrée réduite.

Correction de continuité : comme \(X\) est discrète et la loi normale est continue, on améliore l’approximation en ajoutant \(\pm 0{,}5\) aux bornes :

\(\displaystyle P(a \leq X \leq b) \approx \Phi\!\left(\displaystyle\frac{b + 0{,}5 – np}{\sqrt{np(1-p)}}\right) – \Phi\!\left(\displaystyle\frac{a – 0{,}5 – np}{\sqrt{np(1-p)}}\right)\)

où \(\Phi\) est la fonction de répartition de \(\mathcal{N}(0,\,1)\).

Exemple

On lance 100 fois une pièce équilibrée. \(X \sim B(100\,;\,0{,}5)\). Approcher \(P(45 \leq X \leq 55)\).

\(np = 50\), \(\sigma = \sqrt{100 \times 0{,}5 \times 0{,}5} = 5\). Les conditions \(np = 50 \geq 5\) et \(n(1-p) = 50 \geq 5\) sont remplies.

Avec correction de continuité :

\(\displaystyle P(45 \leq X \leq 55) \approx \Phi\!\left(\displaystyle\frac{55{,}5 – 50}{5}\right) – \Phi\!\left(\displaystyle\frac{44{,}5 – 50}{5}\right) = \Phi(1{,}1) – \Phi(-1{,}1)\)

Par symétrie de la loi normale : \(\Phi(1{,}1) – \Phi(-1{,}1) = 2\,\Phi(1{,}1) – 1 \approx 2 \times 0{,}8643 – 1 = 0{,}729\).

Il y a environ 73 % de chances d’obtenir entre 45 et 55 « pile » sur 100 lancers.

Ces approximations sont des outils puissants pour les grandes valeurs de \(n\). Passons maintenant à la pratique avec des exercices progressifs.

VI. Exercices corrigés

Voici 5 exercices classés par difficulté croissante (★ à ★★★). Chaque correction est détaillée pas à pas. Pour un entraînement complet, retrouve nos exercices corrigés sur la loi binomiale.

Exercice 1 ★ — Calcul direct

On lance un dé équilibré à 6 faces, 4 fois de suite. Soit \(X\) le nombre de fois où l’on obtient un 6.

- Justifier que \(X\) suit une loi binomiale et préciser ses paramètres.

- Calculer \(P(X = 1)\).

- Calculer \(P(X = 0)\) et interpréter.

▶ Voir la correction

a) On répète \(n = 4\) fois la même expérience (lancer un dé), de manière indépendante. Chaque lancer a deux issues : « obtenir un 6 » (succès, \(p = \displaystyle\frac{1}{6}\)) ou « ne pas obtenir un 6 » (échec). Les 4 conditions sont vérifiées :

\(X \sim B\!\left(4\,;\,\displaystyle\frac{1}{6}\right)\)

b) On applique la formule avec \(k = 1\) :

\(\displaystyle P(X = 1) = {4 \choose 1} \times \left(\displaystyle\frac{1}{6}\right)^{\!1} \times \left(\displaystyle\frac{5}{6}\right)^{\!3} = 4 \times \displaystyle\frac{1}{6} \times \displaystyle\frac{125}{216} = \displaystyle\frac{500}{1296} = \displaystyle\frac{125}{324} \approx 0{,}386\)

c)

\(\displaystyle P(X = 0) = \left(\displaystyle\frac{5}{6}\right)^{\!4} = \displaystyle\frac{625}{1296} \approx 0{,}482\)

Il y a environ 48 % de chances de n’obtenir aucun 6 en 4 lancers : c’est le résultat le plus probable.

Exercice 2 ★ — Événement contraire

Un tireur atteint sa cible avec une probabilité \(0{,}7\) à chaque tir. Il effectue 6 tirs indépendants. Soit \(X\) le nombre de tirs réussis.

- Quelle loi suit \(X\) ?

- Calculer la probabilité qu’il atteigne la cible au moins une fois.

▶ Voir la correction

a) 6 tirs indépendants, probabilité de succès \(p = 0{,}7\) identique à chaque tir :

\(X \sim B(6\,;\,0{,}7)\)

b) On cherche \(P(X \geq 1)\). Par l’événement contraire :

\(P(X \geq 1) = 1 – P(X = 0) = 1 – (1 – 0{,}7)^6 = 1 – 0{,}3^6\)

\(0{,}3^6 = 0{,}000729\)

\(P(X \geq 1) = 1 – 0{,}000729 \approx 0{,}999\)

Le tireur a plus de 99,9 % de chances de toucher la cible au moins une fois.

Exercice 3 ★★ — Contrôle qualité (type bac)

Dans une usine, 3 % des pièces produites sont défectueuses. On prélève au hasard un échantillon de 15 pièces (la production est assez grande pour assimiler le prélèvement à un tirage avec remise). Soit \(X\) le nombre de pièces défectueuses.

- Justifier que \(X \sim B(15\,;\,0{,}03)\).

- Calculer \(P(X = 0)\). Interpréter.

- Calculer \(E(X)\) et \(\sigma(X)\). Interpréter.

▶ Voir la correction

a) On prélève \(n = 15\) pièces. Chaque pièce est défectueuse avec probabilité \(p = 0{,}03\), indépendamment des autres (production grande). Donc \(X \sim B(15\,;\,0{,}03)\).

b)

\(P(X = 0) = (1 – 0{,}03)^{15} = 0{,}97^{15} \approx 0{,}633\)

Il y a environ 63 % de chances qu’aucune pièce de l’échantillon ne soit défectueuse.

c)

\(E(X) = 15 \times 0{,}03 = 0{,}45\)

\(\sigma(X) = \sqrt{15 \times 0{,}03 \times 0{,}97} = \sqrt{0{,}4365} \approx 0{,}66\)

En moyenne, on trouve 0,45 pièce défectueuse par échantillon, avec un écart-type de 0,66. La plupart des échantillons contiennent 0 ou 1 pièce défectueuse.

Exercice 4 ★★ — Recherche de paramètre

Soit \(X\) une variable aléatoire suivant la loi \(B(n\,;\,0{,}4)\). On sait que \(E(X) = 8\).

- Déterminer \(n\).

- Calculer \(V(X)\) et \(\sigma(X)\).

▶ Voir la correction

a) \(E(X) = np = n \times 0{,}4 = 8\), donc \(n = \displaystyle\frac{8}{0{,}4} = 20\).

b)

\(V(X) = np(1-p) = 20 \times 0{,}4 \times 0{,}6 = 4{,}8\)

\(\sigma(X) = \sqrt{4{,}8} \approx 2{,}19\)

Exercice 5 ★★★ — Problème de synthèse (type bac)

Un QCM comporte 10 questions indépendantes. Chaque question propose 4 réponses dont une seule est correcte. Un élève répond au hasard à toutes les questions.

- Soit \(X\) le nombre de bonnes réponses. Justifier que \(X\) suit une loi binomiale et préciser ses paramètres.

- Calculer la probabilité d’obtenir exactement 5 bonnes réponses.

- Calculer la probabilité d’obtenir au moins 3 bonnes réponses.

- L’examen est réussi si l’élève obtient au moins 5 bonnes réponses. Calculer la probabilité de réussir par hasard. Commenter.

▶ Voir la correction

a) L’élève répond à \(n = 10\) questions, de manière indépendante. À chaque question, la probabilité de bonne réponse est \(p = \displaystyle\frac{1}{4} = 0{,}25\). Les 4 conditions sont réunies :

\(X \sim B(10\,;\,0{,}25)\)

b)

\(\displaystyle P(X = 5) = {10 \choose 5} \times 0{,}25^5 \times 0{,}75^5 = 252 \times 0{,}000\,977 \times 0{,}2373 \approx 0{,}058\)

c) On utilise l’événement contraire : \(P(X \geq 3) = 1 – P(X \leq 2)\).

\(P(X = 0) = 0{,}75^{10} \approx 0{,}0563\)

\(\displaystyle P(X = 1) = {10 \choose 1} \times 0{,}25 \times 0{,}75^9 = 10 \times 0{,}25 \times 0{,}0751 \approx 0{,}1877\)

\(\displaystyle P(X = 2) = {10 \choose 2} \times 0{,}25^2 \times 0{,}75^8 = 45 \times 0{,}0625 \times 0{,}1001 \approx 0{,}2816\)

\(P(X \leq 2) \approx 0{,}0563 + 0{,}1877 + 0{,}2816 = 0{,}526\)

\(P(X \geq 3) \approx 1 – 0{,}526 = 0{,}474\)

d) On calcule \(P(X \geq 5) = 1 – P(X \leq 4)\). Il faut ajouter :

\(\displaystyle P(X = 3) = {10 \choose 3} \times 0{,}25^3 \times 0{,}75^7 = 120 \times 0{,}015625 \times 0{,}1335 \approx 0{,}250\)

\(\displaystyle P(X = 4) = {10 \choose 4} \times 0{,}25^4 \times 0{,}75^6 = 210 \times 0{,}003906 \times 0{,}1780 \approx 0{,}146\)

\(P(X \leq 4) \approx 0{,}526 + 0{,}250 + 0{,}146 = 0{,}922\)

\(P(X \geq 5) \approx 1 – 0{,}922 = 0{,}078\)

Conclusion : la probabilité de réussir l’examen par hasard est d’environ 7,8 %. Le QCM discrimine bien entre un élève qui a révisé et un élève qui coche au hasard.

Tu veux t’entraîner davantage ? Découvre nos exercices corrigés sur la loi binomiale, du calcul direct aux problèmes type bac.

La fiche de révision « Loi binomiale » à imprimer

Formule de P(X = k), espérance, variance, conditions d’application et arbre de décision pour les approximations — tout sur une seule page recto-verso.

Idéale pour tes révisions de bac ou de DS — à glisser dans ton classeur.

VII. Erreurs fréquentes et pièges classiques

Voici les erreurs les plus fréquentes que je rencontre chez mes élèves sur la loi binomiale. Lis-les attentivement pour ne pas tomber dans le panneau le jour du bac.

Piège n°1 — Appliquer la loi binomiale sans vérifier l’indépendance

❌ « On tire 5 cartes sans remise dans un jeu de 32. X = nombre d’as. Donc X suit B(5 ; 4/32). »

Diagnostic : le tirage sans remise rend les épreuves dépendantes. La probabilité de tirer un as change après chaque carte tirée.

✅ Si le tirage est avec remise, ou si la population est très grande par rapport à l’échantillon (règle usuelle : taille échantillon < 10 % de la population), on peut utiliser la loi binomiale.

Piège n°2 — Confondre P(X = k) et P(X ≤ k)

❌ L’énoncé dit « au plus 3 succès » et l’élève calcule P(X = 3).

✅ « Au plus 3 » = \(P(X \leq 3) = P(X=0) + P(X=1) + P(X=2) + P(X=3)\).

« Exactement 3 » = \(P(X = 3)\). Ce n’est pas la même chose !

Piège n°3 — Inverser les exposants

❌ \(P(X = k) = {n \choose k}\,p^{n-k}\,(1-p)^k\)

✅ Retiens : l’exposant de \(p\) est toujours \(k\) (le nombre de succès) et celui de \((1-p)\) est \(n – k\) (le nombre d’échecs). Vérifie : la somme des deux exposants doit valoir \(n\).

Piège n°4 — Oublier le coefficient binomial

❌ \(P(X = k) = p^{\,k}\,(1-p)^{n-k}\)

✅ Le facteur \({n \choose k}\) est indispensable : il compte le nombre de chemins possibles pour obtenir exactement \(k\) succès parmi \(n\) épreuves. Sans lui, on ne calcule la probabilité que d’un seul chemin particulier.

VIII. Questions fréquentes

C'est quoi la loi binomiale en maths ?

La loi binomiale \(B(n,\,p)\) est une loi de probabilité discrète qui modélise le nombre de succès obtenus lors de \(n\) répétitions indépendantes d’une même expérience à deux issues (succès avec probabilité \(p\), échec avec probabilité \(1 – p\)). C’est l’une des lois fondamentales du programme de Terminale spécialité Mathématiques et de classes préparatoires.

Comment reconnaître qu'une situation suit une loi binomiale ?

Vérifie ces 4 conditions : (1) le nombre d’épreuves \(n\) est fixé à l’avance, (2) chaque épreuve a exactement deux issues (succès ou échec), (3) les épreuves sont indépendantes, (4) la probabilité de succès \(p\) est identique à chaque épreuve. Si les 4 conditions sont réunies, le nombre total de succès suit \(B(n,\,p)\).

Comment calculer P(X = k) avec la loi binomiale ?

Applique la formule en 4 étapes : (1) identifie \(n\) et \(p\), (2) calcule le coefficient binomial \({n \choose k}\), (3) calcule \(p^k\) et \((1-p)^{n-k}\), (4) multiplie les trois termes. Résultat : \(P(X = k) = {n \choose k}\,p^{\,k}\,(1-p)^{n-k}\). Sur calculatrice, utilise la fonction binompdf.

Quelle est la différence entre loi binomiale et loi de Bernoulli ?

La loi de Bernoulli \(B(p)\) modélise une seule épreuve à deux issues. La loi binomiale \(B(n,\,p)\) modélise le nombre de succès sur \(n\) épreuves de Bernoulli indépendantes. Autrement dit, \(B(1,\,p) = B(p)\) : la loi de Bernoulli est le cas particulier de la binomiale avec \(n = 1\).

Quelle est la différence entre loi binomiale et loi de Poisson ?

La loi binomiale \(B(n,\,p)\) modélise le nombre de succès en \(n\) épreuves fixées, tandis que la loi de Poisson \(\mathcal{P}(\lambda)\) modélise le nombre d’événements rares sur un intervalle continu (temps, surface…). Quand \(n\) est grand et \(p\) petit, la loi \(B(n,\,p)\) peut être approchée par \(\mathcal{P}(np)\).

Comment calculer P(X ≤ k) ou P(X ≥ k) avec la loi binomiale ?

Pour \(P(X \leq k)\), additionne toutes les probabilités de 0 à \(k\) : \(P(X \leq k) = P(X=0) + P(X=1) + \cdots + P(X=k)\). Pour \(P(X \geq k)\), utilise l’événement contraire : \(P(X \geq k) = 1 – P(X \leq k-1)\). Sur calculatrice, la fonction binomcdf donne directement \(P(X \leq k)\).

À quoi servent l'espérance et la variance de la loi binomiale ?

L’espérance \(E(X) = np\) donne le nombre moyen de succès attendus. La variance \(V(X) = np(1-p)\) mesure la dispersion autour de cette moyenne : plus elle est grande, plus les résultats sont « éparpillés ». L’écart-type \(\sigma = \sqrt{np(1-p)}\) donne cette dispersion dans la même unité que \(X\).

Pour aller plus loin

Tu maîtrises maintenant la loi binomiale, de la définition aux approximations. Pour approfondir, voici les ressources complémentaires du cours sur les variables aléatoires :

- Espérance d’une variable aléatoire — définition générale, propriétés et calculs détaillés.

- Variance et écart-type — formules, interprétation et démonstrations complètes.

- Loi normale et table de la loi normale centrée réduite — indispensables pour l’approximation de Moivre-Laplace.

- Loi de Poisson — pour l’approximation des événements rares.

- Loi géométrique — quand tu cherches le rang du premier succès plutôt que le nombre total de succès.

- Fonction de répartition et densité — le cadre général pour les lois discrètes et continues.

- Exercices corrigés sur la loi binomiale — pour t’entraîner dans les conditions du bac et des concours.